黑客用AI换脸技术应聘 人工智能安全问题不容忽视

黑客用AI换脸技术应聘 人工智能安全问题不容忽视

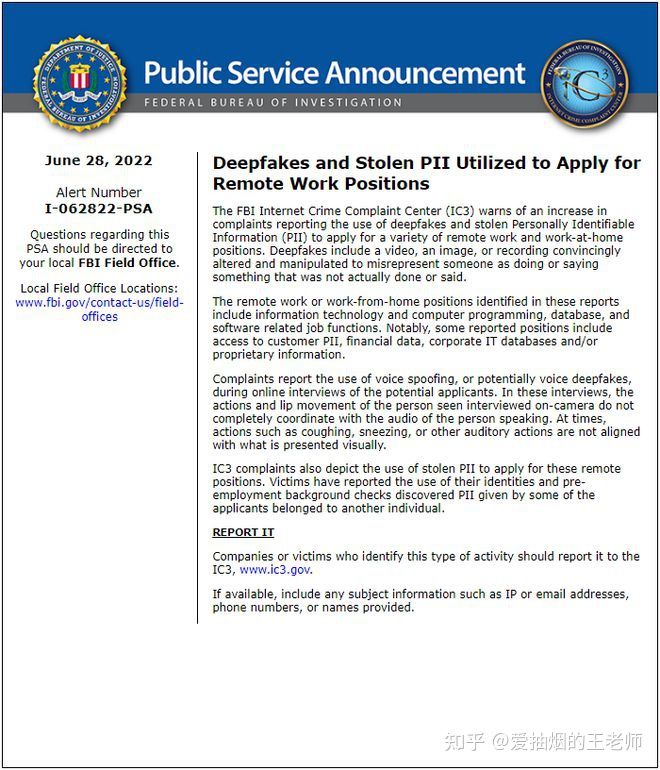

6月28日,FBI发布了一则公告,揭露了有人利用Deepfake技术,在远程应聘中假扮成他人的情况。

美国在疫情后,很多企业都采用在家工作(Work From Home,WFH)模式。美国联邦调查局(FBI)的犯罪投诉中心表示,他们近期接到许多企业雇主的投诉,在招聘过程中,有求职者盗用他人的身份,并且利用Deepfake技术参加远程面试。

这些职位涉及资讯技术、计算机程序、数据库与软件相关领域,有些求职者企图利用他人的背景与专长来获取工作,通过Deepfake技术来伪造视频。

他们发现,当与求职者进行线上面试时,求职者的动作或嘴唇的开合,与其说话的声音并不一致,例如当出现打喷嚏或咳嗽的声音时,画面并未同步。

时候他们对这些求职者进行背调时发现,有些求职者其实在利用他人的身份来谋职。如果仅仅谋职还是小问题,但如果是黑客,一旦他们成功签约,就能够成功进入企业内部,接触到机密数据。

你是不是也很好奇,这软件这么好用吗?

答案是,的确很高级。

Deepfake利用生成对抗网络(GAN)强大的图像生成能力,可以将任意的现有图像和视频组合并叠加到源图像和视频上,它可以记录一个人面部的细节。经过多年的发展,Deepfake技术已经可以进行实时换脸,并且毫无违和感。

不过,在视频时, Deepfakes 难以为面部动态表情制作高置信度动画,视频中的要么就从不眨眼,或者眨眼过于频繁或不自然。而且音频与假人图像也会配合的不够自然。

所以这种视频持续10秒就会让人怀疑,面试全程时间会比较长,更加容易露出破绽。

科学技术的进步和变革是一把双刃剑。

人工智能技术虽然为我们提供了海量的便利,但同时也可能带来的安全、伦理、隐私等一系列问题。

人工智能发展的本质是通过算法、算力和数据去解决完全信息和结构化环境下的确定性问题。在这个数据支撑的时代,人工智能面临诸多的安全风险,

首先,有可能面对毒化攻击。

也就是黑客注入恶意数据来降低AI系统的可靠性和精确度,从而导致人工智能决策错误。在训练数据里加入伪装数据、恶意样本等,破坏数据的完整性,进而导致训练的算法模型决策出现偏差。

这种操作如果用于自动驾驶领域,很可能导致车辆违反交通规则甚至造成交通事故。

其次,会存在数据泄露的问题。

逆向攻击可导致算法模型内部的数据泄露,现在各种智能设备例如智能手环、智能音箱生物特征识别系统、智能医疗系统被广泛的应用,个人信息采集被全方位采集。包括人脸、指纹、声纹、虹膜、心跳、基因等,这些信息具有唯一性和不变性,一旦泄露或者滥用将产生严重后果。

比如曾被曝光的,国内大量门店在不经用户同意的情况下,采集的大量的人脸照片被泄露,这些人脸照片或多或少已经在黑产上流出,就会存在诈骗或者金融安全的风险。

再次,会面临网络风险。

人工智能不可避免地会引入网络连接,人工智能技术本身也能够提升网络攻击的智能化水平,进而进行数据智能窃取和数据勒索攻击或者自动生成大量虚假威胁情报,对分析系统实施攻击。

那么主要的攻击手段则包括:绕过攻击、推断攻击、后门攻击、模型抽取攻击、归属推断攻击木马攻击、模型逆转攻击、反水印攻击、重编程攻击。

我们要清楚的认识到,人工智能的时代数据安全也面临了很多新的挑战。保护数据安全保护算法安全,对于企业来说成为重中之重。